DoE-Happen #63

Serie: Warum Faktoreffekte oft unsichtbar bleiben, Teil 6 von 17 – Wechselwirkungen mit der Umgebung überlagern Haupteffekte. Bzw.: “Warum die Schlieren, nicht auf die Einstellungen hörten“

Du kennst diese Fälle, bei denen du am Ende denkst: Wie konnten wir das so lange übersehen?

Bei uns waren es Schlieren auf Spritzgussteilen. Tagsüber tauchten sie auf, nachts manchmal weniger – oder einfach anders. Also machten wir das, was man in so einem Moment macht: Wir schraubten an den Einstellungen, diskutierten über Zylindertemperaturen, Nachdruck, Umschaltpunkt, Kühlung. …. Das Übliche. Und das Tückische: Die Beobachtungen gaben uns zunächst sogar Rückenwind. Einzelne Parameter wirkten „auffällig“, als hätten wir den Schuldigen fast schon im Griff. Aber je länger wir hinsahen, desto widersprüchlicher wurde das Bild: Der Effekt war nicht stabil. Heute deutlich, morgen weg. Einmal positiv, einmal negativ. Als würde der Prozess je nach Tagesform nach einem anderen Regelwerk spielen. Bis klar wurde: Wir suchten am falschen Ort – der Auslöser lag nicht in den Einstellungen. Ein klassischer Fall von „Verschlimmbesserung“!

Warum das wie ein Einstellungsproblem aussah …

In solchen Momenten ist man schnell versucht, die Statistik zum Schiedsrichter zu machen:

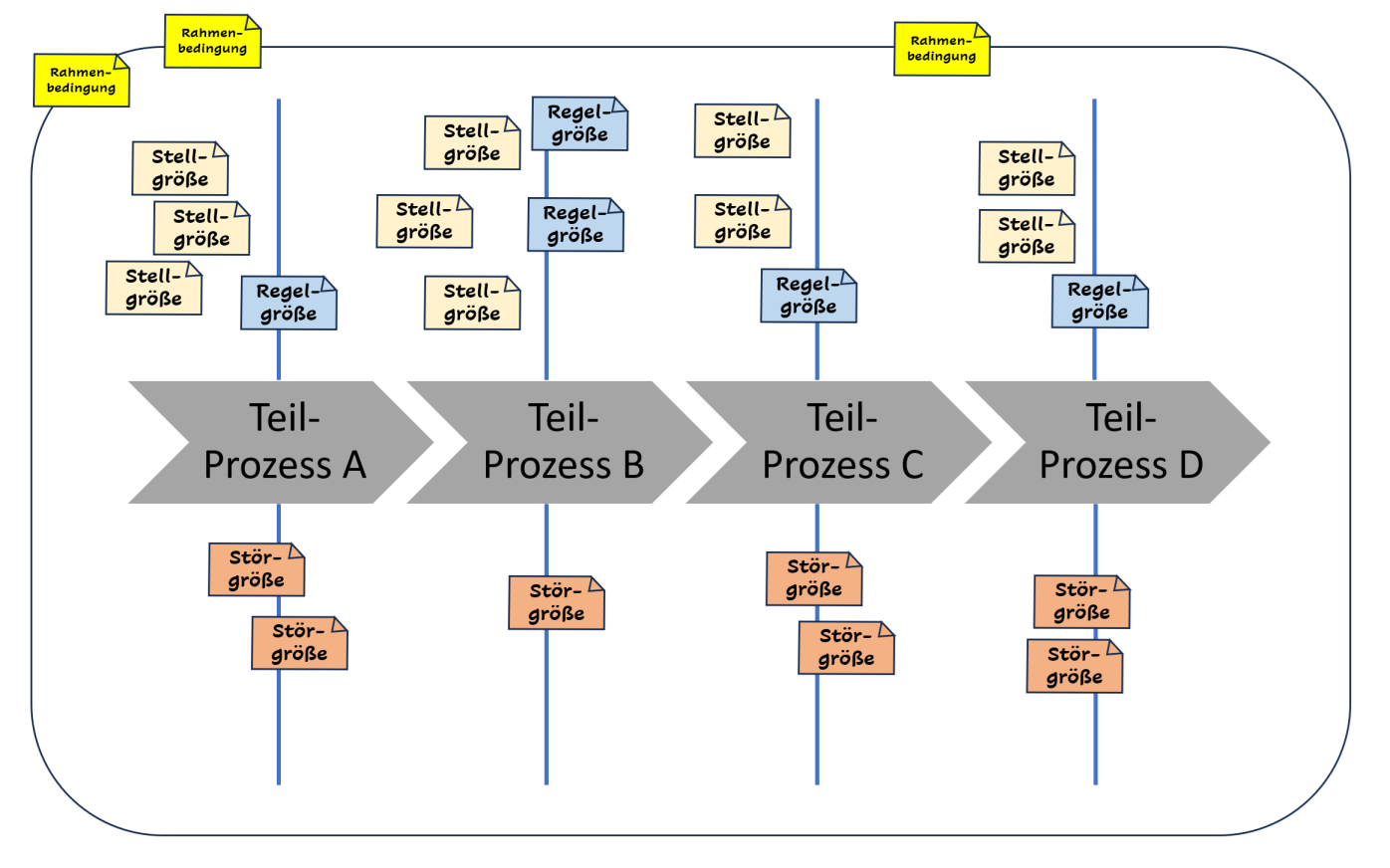

„Wenn ein Parameter signifikant ist, dann muss er doch der Hebel sein.“ Genau hier beginnt das Problem. Denn ein DoE kann dir sehr sauber zeigen, welche Stellgrößen wirklich etwas bewirken – wenn der Kontext stimmt. Wenn aber im Hintergrund ‘unsichtbare’ Rahmenbedingungen mitlaufen (Schicht, Materialzustand, Klima), dann misst du plötzlich nicht mehr Ursache, sondern Mitläufer. Dann wird aus einem DoE schnell ein sehr teurer Korrelations-Detektor.

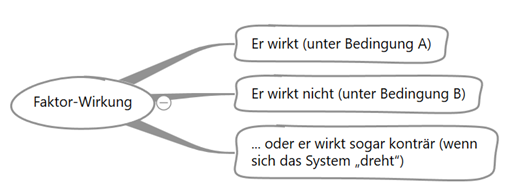

Bei den Schlieren sah es zunächst so aus, als wären es die Einstellungen. Nicht, weil die Maschine plötzlich magisch launisch wurde, sondern weil sich im Hintergrund etwas veränderte, das im DoE gar nicht als Faktor auftauchte: die Rahmenbedingungen. Und sobald solche Rahmenbedingungen wechseln, kann ein Faktor drei Gesichter bekommen:

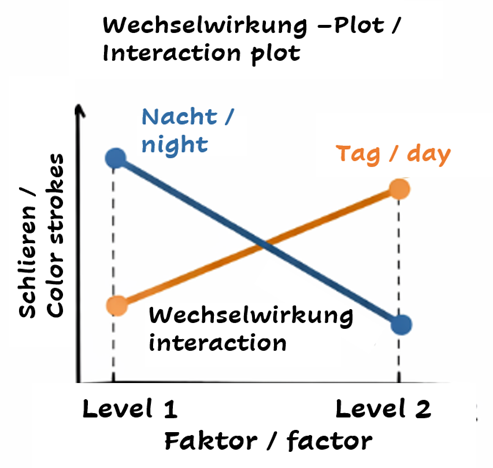

Dann wirkt dieselbe Stellgröße je nach „Umgebungszustand“ plötzlich anders – also je nachdem, ob Temperatur, Feuchte, Schicht oder Materialzustand gerade mitspielen. Technisch steckt dahinter oft eine Wechselwirkung: Die Einstellung wirkt nicht für sich allein, sondern je nachdem, was im Hintergrund gerade mitläuft. Das fühlt sich in der Auswertung erst mal wie ein Widerspruch an – in Wahrheit ist es häufig ein Hinweis darauf, dass du zwei unterschiedliche Prozesswelten oder Systeme in einen Datensatz nicht unterscheidbar vereinigt hast.

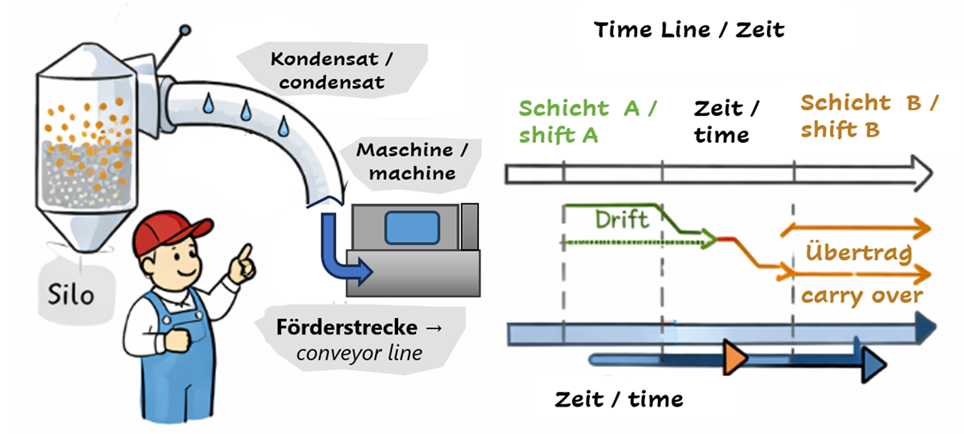

Beispiel: Heinz, unser virtueller Student (taucht zuverlässig auf, wenn’s brenzlig wird), fährt tagsüber Versuche bei 28 °C Hallentemperatur. Nachts sind’s 18 °C – und plötzlich hast du Kondensat an Stellen, die tagsüber trocken sind. Entsprechend ändert sich dein Fehlerbild/Ausschuss. In der Analyse sieht das aus wie „ein“ Datensatz. In Wirklichkeit sind es zwei Systeme. Und zwei Systeme können denselben Parameter eben komplett unterschiedlich wirken lassen.

Die Folge: Effekte können sich egalisieren. Was in der Tagesschicht klar sichtbar ist, wird in der Nachtschicht abgeschwächt oder kehrt sich um – und im Gesamtbild bleibt am Ende: „nichts Signifikantes“. Nicht, weil nichts passiert, sondern weil sich die Wirkungen gegenseitig überdecken. Und es kommt noch dazu: Manche Effekte, die sich in einer Schicht aufbauen, können in die Folgeschicht hineinreichen – dann verschwimmen die Grenzen zusätzlich.

Und genau an dieser Stelle wird’s gefährlich: Wenn du den Kontext nicht siehst, suchst du weiter dort, wo du messen kannst – bei den Einstellungen. Dabei liegt die Ursache häufig dort, wo du sie zuerst nicht vermutest: im Materialfluss, in der Umgebung oder in einem Prozessschritt, der „eigentlich“ nur Logistik ist.

Die Auflösung: Der Faktor lag nicht in der Maschine

Durchbruch kam erst, als wir aufgehört haben, ausschließlich „im Feld der Maschine“ zu suchen, und stattdessen den Prozess als Kette betrachteten: Woher kommt das Material, was passiert bis zur Maschine – und was kann sich zwischen Tag- und Nachtschicht unbemerkt verändern?

Dabei zeigte sich etwas, das im Rückblick fast banal wirkt – damals war es das überhaupt nicht: Der Rohstoff war in Tag- und Nachtschicht unterschiedlich stark Kondensat im Silo ausgesetzt. Nicht die Einstellungen hatten sich „verstellt“, sondern der Ausgangszustand des Granulats war ein anderer – und damit auch das, was sich in der Schmelze und später an der Oberfläche der Spritzgussteile zeigte. Gerade deshalb eignet sich der Fall so gut als Illustration: Erst im Nachhinein sieht die Ursache „offensichtlich“ aus.

Das Gemeine daran: Das Material war nicht hygroskopisch – es zieht also nicht ‘wie ein Schwamm’ Wasser aus der Luft. Genau deshalb denkt man schnell: Feuchte ist ausgeschlossen. In der Praxis reicht aber oft schon Kondensat als dünner Film auf Granulat, Silo-Wand oder Förderstrecke, um optische Effekte zu triggern – ganz ohne klassisches ‘Nassgranulat’.

Und damit waren wir an dem Punkt, an dem Statistik allein nicht mehr weiterhilft. Jetzt braucht’s Detektivarbeit entlang der Prozesskette – und dafür gibt’s ein paar bewährte Denkhilfen, je nachdem, wo man gerade feststeckt.

Manchmal reicht ein SIPOC, um die Prozessschritte sauber zu trennen und den Materialpfad einmal wirklich sichtbar zu machen. Manchmal ist ein Ishikawa besser, weil es einen zwingt, auch Material, Milieu und Handhabung mit auf den Tisch zu legen – selbst wenn der Kopf eigentlich schon nur noch bei Maschineneinstellungen ist. Und wenn die Frage eher „Warum passiert das überhaupt?“ lautet, kann eine FAST-Analyse helfen, die Funktion so lange herunterzubrechen, bis die Ursache eine halbwegs plausible „Adresse“ bekommt. Für den Fokus zwischendurch tun’s oft schon die Bilderrahmen-Metapher (In/Out) oder ein kurzes Pareto-Ranking.

In unserem Fall hätte eine dieser Methoden gereicht. Entscheidend war nicht, welches Tool wir nehmen – sondern dass die Rahmenbedingungen endlich einen festen Platz im Denken bekommen haben (und nicht nur als „Wetter“ irgendwo am Rand mitlaufen).

Die eigentliche Team Lektion war: „Effekte brauchen Kontext“

Der Fall hat uns weniger über Spritzguss gelehrt als über Interpretation: Ein Faktoreffekt ist nicht einfach „da“ oder „nicht da“ – er ist oft kontextabhängig. Wenn sich Rahmenbedingungen ändern, kann derselbe Faktor plötzlich anders wirken. Und wenn diese Rahmenbedingungen im Versuch nicht sichtbar gemacht oder kontrolliert werden, passiert etwas sehr Typisches: Die Ergebnisse werden widersprüchlich, Effekte scheinen zu verschwinden – und am Ende diskutiert man über „nicht signifikant“, obwohl der Prozess sehr wohl reagiert.

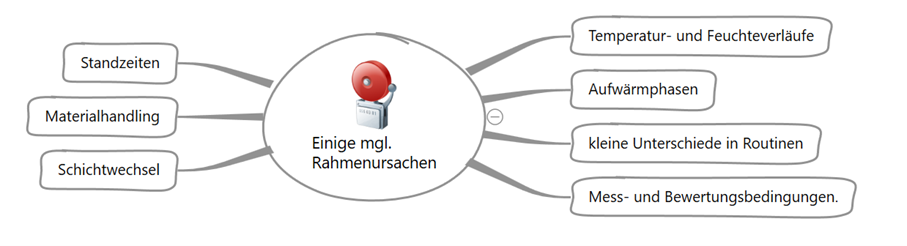

Das Entscheidende ist deshalb nicht, jedem Ausschlag hinterherzulaufen, sondern früh die richtige Frage zu stellen: Welche Rahmenbedingungen könnten meinen Effekt tragen oder drehen? In der Praxis sind dies selten exotische Dinge. Häufig sind es ganz alltägliche Prozessrealitäten: Schichtwechsel, Materialhandling, Standzeiten, Temperatur- und Feuchteverläufe, Aufwärmphasen, kleine Unterschiede in Routinen oder auch Mess- und Bewertungsbedingungen. Sobald man diese Faktoren als Teil des Systems akzeptiert, wird aus „launischer Statistik“ wieder ein logischer Prozess.

Solange solche Kontextfaktoren nicht sauber adressiert sind, passiert fast immer das Gleiche: Teams untersuchen immer mehr „kleine“ Variablen – in der Hoffnung, irgendwo noch den einen Einstellhebel zu finden, der den Knoten löst. Das fühlt sich dann an wie ein Fortschrittsbalken bei 95 %: viel Bewegung, viel „grünes Licht“, ein paar scheinbare Treffer – und trotzdem sagt dieser Stand noch nicht, ob du wirklich kurz vor dem Ziel bist.

Denn oft sind genau die letzten Prozent an eine übersehene Rahmenbedingung gekoppelt. Solange diese nicht kontrolliert oder geändert wird, bleiben die „letzten 5 %“ schlicht zäh oder sogar unlösbar – egal, wie viele Stellschrauben du noch drehst. Und genau deshalb ist der Gedanke trügerisch, das Reststück ließe sich jetzt „schnell“ erledigen, nur weil man schon so weit gekommen ist.

Das kann die Situation sogar verschärfen: Man bekommt mehr Kandidaten, mehr scheinbare Treffer, mehr Diskussionen – aber nicht zwingend mehr Wahrheit. Genau deshalb lohnt es sich, an dieser Stelle bewusst zu bremsen und den Blick zu weiten: erst Prozesslandkarte, dann Hypothesen – und erst dann wieder Parameter. Frühwarntipp: Frag dich im Team regelmäßig: „Wie viel Zeit verbringen wir gerade damit, über das Offensichtliche zu diskutieren – statt die Rahmenbedingungen sichtbar zu machen?“

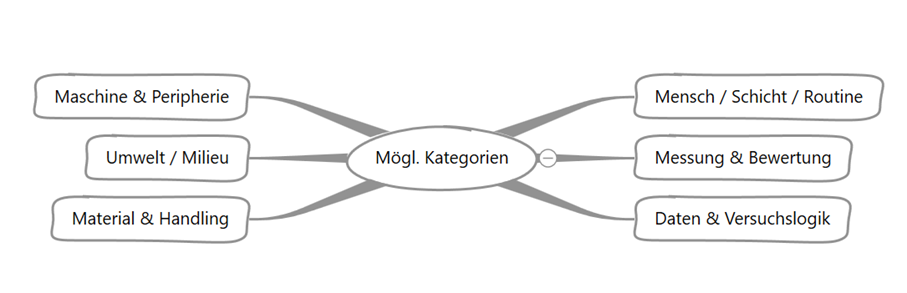

Mindmap: „Woher kommen diese Rahmenbedingungen – und warum kippen sie Effekte?“

Wenn man solche Fälle ein paar Mal erlebt hat, merkt man: Die Ursache ist selten „mysteriös“. Sie ist nur nicht dort, wo wir beim ersten Reflex suchen. Deshalb hilft eine Mindmap als Gegenmittel: Sie zwingt uns, den Prozess breit zu betrachten – und macht typische Quellen für Rahmenbedingungen sichtbar, die Effekte drehen, überdecken oder scheinbar verschwinden lassen. Alternativ auch unter anderem Brainwriting, oder TRIZ aus den Liberating Structures.

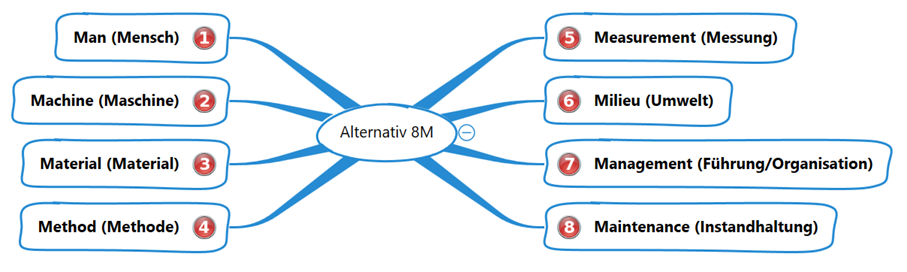

Alternativ kannst du denselben Perspektivwechsel auch mit einem 4M-/5M-/6M- bis hin zum 8M-Modell strukturieren – je nachdem, wie detailliert du deinen Prozess aufspannen möchtest. Der Vorteil: Diese Struktur bringt systematisch Aspekte auf den Tisch, die in „normalen“ Meetings leicht untergehen. Oft ist das wesentlich wirksamer als eine freie Diskussion ohne roten Faden – besonders, wenn die Ergebnisse sichtbar festgehalten werden (z.B. Flipchart), mit Entscheidungen dokumentiert sind und Maßnahmen inkl. Verantwortlichkeiten daraus entstehen (z. B. RACI).

Die klassischen 7M / 8M

- Man (Mensch): Einfluss durch Qualifikation, Verhalten, Erfahrung, Aufmerksamkeit.

- Machine (Maschine): Zustand von Anlagen, Werkzeugen, Software, Automatisierung.

- Material (Material): Rohstoffe, Hilfsstoffe, Bauteile, Qualität, Lieferanten.

- Method (Methode): Arbeitsabläufe, Vorschriften, Prozesse, Standards.

- Measurement (Messung): Prüfverfahren, Messgeräte, Genauigkeit, Kalibrierung.

- Milieu (Umwelt): Umgebungseinflüsse wie Temperatur, Lärm, Licht, Arbeitsplatzbedingungen.

- Management (Führung/Organisation): Strukturen, Verantwortlichkeiten, Planung, Kommunikation.

- Maintenance (Instandhaltung): Wartung, Reparatur, vorbeugende Maßnahmen, Verfügbarkeiten.

Was ist nun „besser“? Aus meiner Sicht geht’s weniger um die perfekte Methode als um den ersten Schritt raus aus der diffusen Diskussion – hin zu einer kurzen, moderierten Problemformulierung, bei der ihr die wichtigsten Einflussrichtungen einmal systematisch abklopft. Sobald dieser Rahmen steht, wird vieles automatisch klarer: worüber ihr wirklich sprecht, was ihr schon wisst – und was ihr gezielt prüfen solltet.

Stell dir den Kern in der Mitte vor: „Widersprüchliche Effekte / scheinbar signifikant, aber unlogisch“. Von dort gehen sechs repräsentative Hauptäste ab. Die folgenden Punkte sind bewusst Inspirationen und Denkimpulse – je nach Prozess und Problemstellung können sie ganz anders benannt oder ergänzt werden.

- Material & Handling: Chargenwechsel, Lagerzeit, Temperaturunterschiede, Förderstrecken, Silosituation, Rezyklatanteil, Kontamination, Verpackung/Anbruch, Standzeiten – alles, was den Ausgangszustand verändert, ohne dass es im Maschinenparameterfenster auftaucht.

- Umwelt / Milieu: Hallentemperatur, Luftfeuchte, Sommer/Winter, Tag/Nacht, Druckluftqualität, offene Tore, Nähe zu Kühlanlagen – Rahmenbedingungen, die „nebenbei“ mitlaufen, aber physikalisch sehr real sind.

- Maschine & Peripherie: Aufwärmphase, Verschleiß, Trockner/Fördergerät, Dichtungen, Temperiergerät, Kühlwasser, Filter, Entlüftung – Dinge, die meist nicht als Faktor im DoE landen, aber den Prozesszustand verändern.

- Mensch / Schicht / Routine: Schichtübergaben, Checklisten, Handgriffe, Reinigungsstandard, unterschiedliche Prioritäten („schnell wieder anfahren“), Erfahrung – kleine Unterschiede, die große Wirkungen triggern können.

- Messung & Bewertung: Beleuchtung, Blickwinkel, Prüfer, Grenzmuster, Kameraeinstellungen, Prüfzeitpunkt und Stichprobenlogik – tückisch, weil der „Fehler“ hier manchmal erst sichtbar gemacht (oder sogar mit erzeugt) wird. Wichtig sind außerdem Messbarkeit, Messmittelfähigkeit (Wiederhol- und Vergleichspräzision) sowie eine klar definierte Mess-/Bewertungsmethode, damit Ergebnisse wirklich vergleichbar sind.

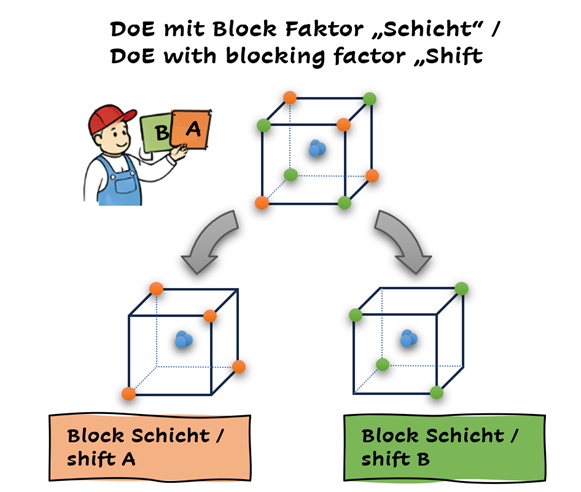

- Daten & Versuchslogik: Randomisierung, Blockbildung (z. B. Schicht als Block), Zeittrend/Drift, gemischte Prozesswelten, fehlende Labels – also alles, was darüber entscheidet, ob das Experiment Ursache und Kontext sauber trennt oder unbemerkt vermischt.

Der Nutzen dieser Mindmap ist ganz praktisch: Beim nächsten „Effekt ist mal da, mal weg“ kannst du sie wie eine Checkliste nutzen. Du musst nicht alles prüfen – aber du bekommst schneller Hypothesen, die physikalisch plausibel sind und den Prozess als System ernst nehmen.

6 – „Wenn du lange genug suchst, findest du immer etwas ….“ Stolpersteine und Fehlannahmen.

An diesem Punkt kommt eine zweite, sehr menschliche Falle ins Spiel: Wenn der Kontext unklar bleibt, steigt der Drang, immer mehr Faktoren zu prüfen – in der Hoffnung, dass „irgendwo“ der fehlende Hebel steckt. Das Problem: Je mehr du testest, desto höher wird die Wahrscheinlichkeit, dass du irgendwann einen Treffer landest, der nur zufällig gut aussieht.

Man kann sich das wie ein Glücksspiel vorstellen: Wenn du nur ein einziges Los ziehst, ist ein Gewinn selten. Ziehst du aber sehr viele Lose, ist es fast sicher, dass irgendwann eins „gewinnt“ – auch wenn die Lotterie keinerlei Bezug zu deinem eigentlichen Problem hat. In der Statistik heißt das: Wenn du genug Variablen testest, bekommst du irgendwann einen ‘Treffer’ – einfach, weil Zufall auch mal schick aussieht. Statistik nennt das „False Positives“: „Signifikanz ohne Ursache“.

Das erklärt auch, warum Teams in solchen Situationen leicht in eine Art Parameter-Hamsterrad geraten: Man findet Kandidaten, optimiert, sieht kurzfristig Verbesserung – und wundert sich, warum es später wieder kippt. Nicht, weil die Leute falsch arbeiten, sondern weil man versucht, ein Kontextproblem mit Parameterarbeit zu erschlagen.

Die Gegenstrategie ist erstaunlich schlicht: erst Kontext klären, dann testen.

Wenn du dir vorab eine Handvoll plausibler Hypothesen aus der Prozesslandkarte/Mindmap ableitest (und diese sauber labelst oder kontrollierst), reduziert sich die Anzahl der „blind“ geprüften Variablen drastisch – und damit auch das Risiko, Zufallskorrelationen für Ursache-Wirkung zu halten. Anders gesagt: Weniger testen, aber klüger testen.

Oft hilft zusätzlich, die möglichen Einflussgrößen paarweise gegeneinander zu bewerten und nach erwarteter Relevanz zu gewichten (z. B. in einer einfachen Paarvergleichs-Matrix). Der eigentliche Wert steckt dabei nicht nur im Ranking, sondern im Prozess: Beim mehrmaligen Durchlaufen wird schnell sichtbar, wo Definitionen uneinheitlich sind, wo Variablen unterschiedlich verstanden werden oder wo das Team implizit von verschiedenen „Problem-Modellen“ ausgeht. Genau diese Klärung ist Gold wert – besonders in moderierten Workshops, idealerweise mit jemandem externen, der nicht zu tief im Tagesgeschäft steckt und dadurch blinde Flecken besser hinterfragen kann.

7 – Praxis-Checkliste: „Was tun, wenn Effekte widersprüchlich sind?“

Wenn ein Faktor „mal wirkt und mal nicht“, ist das kein Zeichen dafür, dass DoE versagt – sondern oft ein Hinweis, dass Kontext fehlt.

Diese Checkliste hilft, schnell von „Parameter-Raten“ zu robuster Ursachenarbeit zu wechseln:

- Stopp: Plausibilität prüfen – Passt der Effekt physikalisch/technologisch zur vermuteten Ursache? Wenn nicht: vermuten, dass der Faktor nur mitläuft – also ein Anzeiger ist, der an der eigentlichen Ursache dranhängt (Verwechslung/Überlagerung von Effekten).

- Rahmenbedingungen sichtbar machen (Labeln): Schicht, Datum/Uhrzeit, Charge, Lagerzeit, Silo/Handling, Hallenklima, Aufwärmphase, Reinigungszustand, Prüfer/Prüfumgebung – alles, was „nebenbei“ mitläuft, bekommt ein Label im Datensatz oder zumindest in der Versuchsdokumentation

- Blocken statt Vermischen: Wenn du Schicht-/Tag-/Charge-Einflüsse vermutest: als Blockfaktor behandeln oder Versuche so planen, dass die Blöcke nicht unbemerkt gemischt werden.

- Randomisieren – wo immer es praktisch geht: Randomisierung verhindert, dass sich Zeitdrift, Aufwärmeffekte, Materialzustand oder Routineunterschiede unbemerkt an einen Faktor „dranhängen“ (und ihn dadurch scheinbar wichtiger machen, als er ist) …Beispiel: Sonst passiert’s schnell, dass ‘Faktor A hoch’ zufällig immer nach der Aufwärmphase läuft – und du am Ende die Aufwärmphase optimierst, nicht den Faktor.

- Zeittrend/Drift explizit checken: Läuft der Prozess über die Zeit weg? (Werkzeugtemperatur, Verschleiß, Aufheizung, Feuchte-/Temperaturverlauf, Materialstandzeit). Ein einfacher Trend-Check spart oft Tage.

- Mess- und Bewertungsbedingungen stabilisieren: Gleiche Beleuchtung, gleiche Grenzmuster, gleiche Kamera-/Prüfeinstellungen, gleiche Stichprobenlogik. Sonst optimierst du am Ende die Sichtbarkeit des Fehlers statt den Fehler.

- Prozesskette ablaufen: SIPOC oder Ishikawa oder FAST: Nicht drei Methoden „weil es sauber klingt“, sondern eine Methode konsequent durchziehen, bis Materialfluss und Kontextpfad wirklich sichtbar sind. Nicht alles ist immer nötig – und wenn es passt, lassen sich einzelne Ansätze auch gezielt kombinieren (z. B. SIPOC für die Kette, Ishikawa für die Ursachenbreite).

- Hypothesen priorisieren (statt Variablen sammeln): Nutzt eine kurze Liste plausibler Hypothesen – gerne mit Paarvergleich/Gewichtung – und entscheidet bewusst, was ihr nicht testet.

- Gezielter Verifikationsversuch statt riesiges Folge-DoE: Wenn eine plausible Hypothese steht (z. B. „Kondensat/Handling“), plane einige sporadische Bestätigungsversuche: eine Variable bewusst setzen/variieren, den Rest konstant halten, und vorab festlegen, woran du die Bestätigung erkennst (z. B. Schlierenrate/Score). Ein solcher fokussierter Check schlägt oft viele weitere Parameterläufe.

- Robustheitsblick: Was muss wahr sein, damit der Effekt stabil bleibt? Nicht nur „Welcher Parameter ist optimal?“, sondern: Unter welchen Schwankungen (Schicht, Klima, Materialzustand) bleibt das Ergebnis gut? Das ist der Schritt von Optimierung zu robustem Prozess und teil der Expertise des Process-Owner.

Merksatz zum Mitnehmen:

Wenn Effekte widersprüchlich sind, fehlt meist Kontext – nicht ein weiterer Faktor. Signifikanz ist ein Hinweis, kein Beweis: Ohne physikalische Plausibilität und sichtbare Rahmenbedingungen optimierst du schnell am falschen Hebel. Trenne Prozesswelten (z. B. labeln/blocken), dann wird der Effekt wieder logisch.Und ein kleines

Und ein kleines Highlight zum Schluss

Alle bisherigen DoE-Beiträge gibt’s jetzt gebündelt in unserer neuen LinkedIn-Gruppe. Dort findest du ältere Inhalte schneller wieder, kannst neue Themen anregen – und dich mit anderen DoE-Interessierten austauschen. Gib gern gezielt Likes und Kommentare: So sehe ich, welche Beiträge und Fragen für die Gruppe am wichtigsten sind, und kann die nächsten Themen entsprechend priorisieren.

👉 Alle 1–2 Wochen kommt ein frischer Blogpost dazu. Ich freue mich auf deine Fragen, Erfahrungen und Diskussionen! Hier geht’s zur Gruppe: https://lnkd.in/d8t4gt74

Und natürlich: Alle Blogs wie gewohnt auch auf meiner Website – inkl. Videos, Tipps & mehr.

Mehr aus Ihren Prozessen rausholen?

Ob DoE-Grundlagen oder Spezialthemen wie Troubleshooting, Screening, Optimierung, Mischungsdesigns oder Robustheit – ich unterstütze Sie mit praxisnahen DoE-Trainings, gezielter Beratung und methodischer Begleitung. Auch bei MVDA, DFSS und QFD bin ich an Ihrer Seite – vom ersten Workshop bis zur robusten Umsetzung.